آموزش توسعه هوش مصنوعی با Qwen 2.5 و Ollama: ساخت برنامههای هوش مصنوعی به صورت محلی - آخرین آپدیت

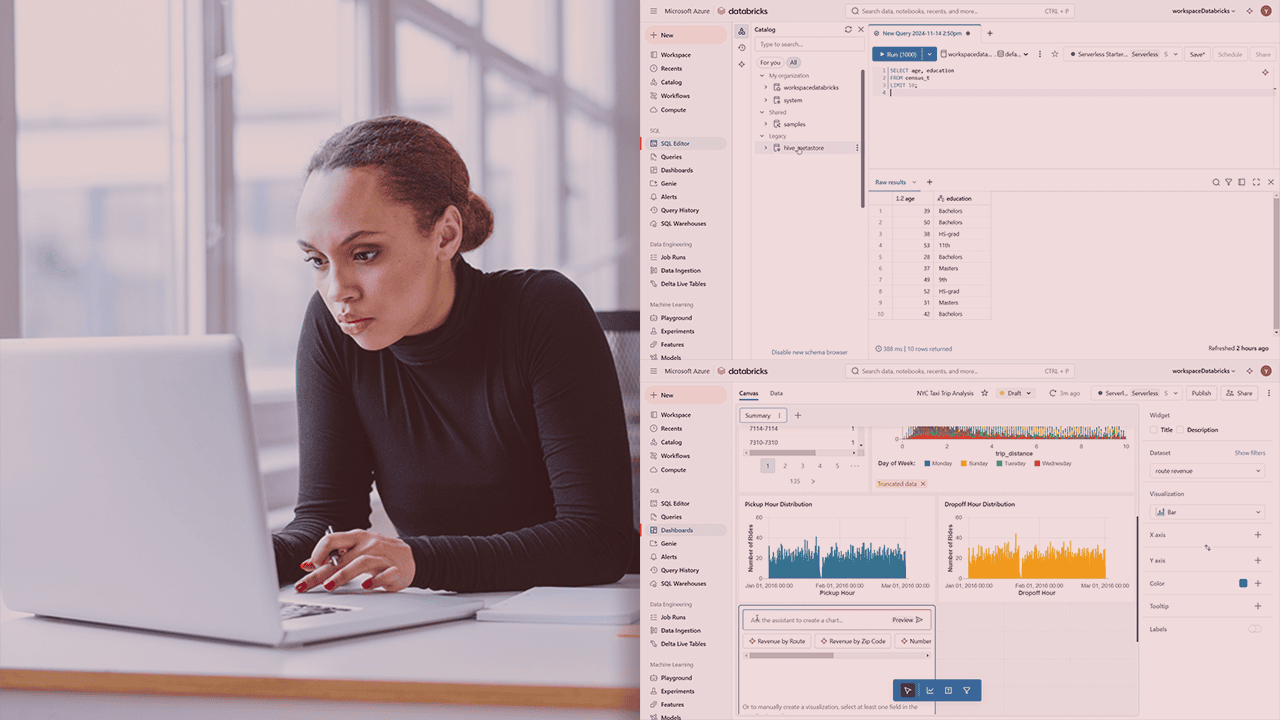

دانلود AI Development with Qwen 2.5 & Ollama: Build AI Apps Locally

با استفاده از Qwen 2.5 و Ollama، برنامههای کاربردی مبتنی بر هوش مصنوعی را به صورت محلی بسازید. آموزش پایتون، FastAPI و توسعه هوش مصنوعی (AI) در دنیای واقعی.

راهاندازی و اجرای Qwen 2.5 روی یک دستگاه محلی با استفاده از Ollama.

درک نحوه عملکرد مدلهای زبانی بزرگ (LLMs).

ساخت برنامههای کاربردی مبتنی بر هوش مصنوعی با استفاده از پایتون و FastAPI.

ایجاد APIهای REST برای تعامل با مدلهای هوش مصنوعی به صورت محلی.

ادغام مدلهای هوش مصنوعی در برنامههای وب با استفاده از React.js.

بهینهسازی و تنظیم دقیق مدلهای هوش مصنوعی برای عملکرد بهتر.

پیادهسازی راهحلهای هوش مصنوعی محلی بدون وابستگی به ابر.

استفاده از Ollama CLI و Python SDK برای مدیریت مدلهای هوش مصنوعی.

استقرار برنامههای کاربردی هوش مصنوعی به صورت محلی و در پلتفرمهای ابری.

کاوش در موارد استفاده واقعی از هوش مصنوعی فراتر از رباتهای گفتگو.

پیشنیازها:

دانش پایهای پایتون (متغیرها، توابع و حلقهها) - اگر ندارید، ما پایتون پایه را پوشش خواهیم داد.

آشنایی با APIها (APIهای REST، مدیریت دادههای JSON).

مهارتهای پایه خط فرمان (اجرای اسکریپتها، نصب بستهها).

یک کامپیوتر با macOS، ویندوز یا لینوکس (برای تنظیم هوش مصنوعی محلی).

اتصال به اینترنت (برای دانلود Qwen 2.5 و وابستگیها).

اختیاری: دانش پایه JavaScript/React (برای توسعه رابط کاربری).

آیا آمادهاید برنامههای کاربردی مبتنی بر هوش مصنوعی را به صورت محلی و بدون اتکا به APIهای مبتنی بر ابر بسازید؟ این دوره عملی به شما آموزش میدهد که چگونه با استفاده از Qwen 2.5 و Ollama، دو ابزار قدرتمند برای اجرای مدلهای زبانی بزرگ (LLMs) روی دستگاه محلی خود، برنامههای کاربردی هوش مصنوعی را توسعه، بهینه و مستقر کنید.

با ظهور مدلهای هوش مصنوعی متنباز، توسعهدهندگان اکنون فرصت دارند تا برنامههای هوشمند ایجاد کنند که متن را پردازش، محتوا را تولید و وظایف را خودکار میکنند - همه اینها در حالی که دادهها را خصوصی و امن نگه میدارند. در این دوره، یاد خواهید گرفت که چگونه Qwen 2.5 را با Ollama نصب، پیکربندی و یکپارچه کنید، بکاندهای هوش مصنوعی مبتنی بر FastAPI بسازید و راهحلهای هوش مصنوعی دنیای واقعی را توسعه دهید.

چرا Qwen 2.5 و Ollama را یاد بگیریم؟

Qwen 2.5 یک مدل زبانی بزرگ (LLM) قدرتمند است که توسط Alibaba Cloud توسعه یافته است و برای پردازش زبان طبیعی (NLP)، تولید متن، استدلال و کمک کد بهینه شده است. برخلاف مدلهای سنتی مبتنی بر ابر مانند GPT-4، Qwen 2.5 میتواند به صورت محلی اجرا شود، که آن را برای برنامههای کاربردی هوش مصنوعی حساس به حریم خصوصی ایدهآل میکند.

Ollama یک ابزار مدیریت مدل هوش مصنوعی است که به توسعهدهندگان اجازه میدهد تا LLMها را به صورت محلی با بازده بالا و تأخیر کم اجرا و مستقر کنند. با Ollama، میتوانید مدلها را دریافت کنید، آنها را در برنامههای خود اجرا کنید و آنها را برای وظایف خاص تنظیم کنید - همه اینها بدون نیاز به منابع گران قیمت ابری.

این دوره عملی و کاربردی است و برای کمک به شما در به کارگیری هوش مصنوعی در پروژههای دنیای واقعی طراحی شده است. چه بخواهید رابطهای چت مبتنی بر هوش مصنوعی، خلاصهکنندههای اسناد، دستیارهای کد یا ابزارهای اتوماسیون هوشمند بسازید، این دوره شما را با مهارتهای لازم مجهز میکند.

چرا این دوره را بگذرانیم؟

- توسعه عملی هوش مصنوعی با پروژههای دنیای واقعی

- عدم اتکا به APIهای ابری - برنامههای هوش مصنوعی خود را خصوصی و امن نگه دارید

- مهارتهای آیندهنگر برای کار با LLMهای متنباز

- استقرار سریع و کارآمد هوش مصنوعی با اجرای محلی Ollama

در پایان این دوره، برنامههای کاربردی مبتنی بر هوش مصنوعی را روی دستگاه خود اجرا خواهید کرد، درک عمیقی از LLMها خواهید داشت و مهارتهای توسعه راهحلهای هوش مصنوعی آینده را کسب خواهید کرد. آیا آماده شروع ساخت هستید؟

بررسی عمیق Qwen 2.5 Deep Dive into Qwen 2.5

-

Qwen 2.5 چیست؟ What is Qwen 2.5?

-

Qwen 2.5 در مقابل مدلهای دیگر - Llama3، GPT-4، Mistral Qwen 2.5 vs. Other Models - Llama3, GPT-4, Mistral

-

Ollama چیست؟ What is Ollama?

-

چرا از Ollama استفاده کنیم؟ Why Use Ollama?

-

Qwen 2.5 و Ollama چگونه با هم کار میکنند؟ How Do Qwen 2.5 & Ollama Work Together?

-

خلاصه بررسی عمیق Qwen 2.5 Summary of Deep Dive into Qwen 2.5

-

شروع سریع پایتون (فقط یک یادآوری) Python Quick Start(Just a Refresher)

چتبات مبتنی بر هوش مصنوعی با Qwen 2.5 و Ollama AI-Powered Chatbot with Qwen 2.5 and Ollama

-

چه چیزی یاد خواهید گرفت What You Will Learn

-

راهاندازی محیط Environment Setup

-

ساخت بکاند چتبات (FastAPI) Building the Chatbot Backend (FastAPI)

-

ساخت فرانتاند React Building the React Frontend

Vivian Aranha

Vivian Aranha

Jet Drag Academy

Jet Drag Academy

نمایش نظرات